24 Haziran 2021 06:07

Onur Erem

Türkiye'de üretilen Kargu-2 adlı silahlı insansız hava aracı (SİHA) bu ayın başında dünya basınının gündemindeydi.

Mart ayında yayımlanan bir Birleşmiş Milletler (BM) raporuna atıf yapılan "Katil robotlar aramızda" başlıklı haberlerde Kargu-2'nin yapay zeka ile hedeflerini vuran ilk SİHA olduğu, bunun geçen yıl Libya'da yaşandığı aktarıldı.

Peki BM raporunda neler yazıyordu? Kargu-2'nin özellikleri neler? Otonom sistemler neden etik tartışmalara yol açıyor?

Kargu-2 hakkında merak edilen sorulara yanıt aradık.

Kargu-2 nedir?

Kargu-2, Savunma Teknolojileri Mühendislik ve Ticaret AŞ (STM) tarafından geliştirilen, küçük boyutlu bir insansız kamikaze hava aracı. STM bunu "Vurucu İHA" (VİHA) olarak tanımlıyor. BM ise Kargu'yu "ölümcül otonom silah sistemi" (LAWS) olarak niteliyor.

STM 1991'de Türk Silahlı Kuvvetleri ve Savunma Sanayii Müsteşarlığı tarafından kurulan bir şirket. 2016 itibarıyla ise yüzde 34'ü Savunma Sanayii Başkanlığı'na, yüzde 34'ü özel bir şirket olan Savronik'e, yüzde 31,9'u ise Türk Silahlı Kuvvetleri'ni Güçlendirme Vakfı'nın sahibi olduğu Havelsan'a ait.

Kargu ise STM'nin internet sitesinde şöyle tanıtılıyor:

"Kargu asimetrik harp veya anti-terör alanlarında kullanılmak üzere tek er tarafından taşınabilen, otonom veya uzaktan kumanda ile çalışabilen, döner kanatlı milli vurucu İHA çözümüdür.

"Kargu platform üzerinde gömülü ve gerçek zamanlı özgün görüntü işleme ve derin öğrenme algoritmalarıyla sabit veya hareketli hedeflere karşı etkin olarak kullanılabilmektedir."

STM Kargu'yu YouTube hesabında ise şu videoyla tanıtıyor:

70x70x40 cm. boyutlarındaki aracın ağırlığı ise 7 kilo.

Kargu'nun gerçek zamanlı nesne tespit, teşhis, takip ve sınıflandırma özelliği bulunuyor.

Farklı türden mühimmatlar taşıyabilen Kargu, hedefinin yakınına kadar gidip patlıyor.

STM bunu "tali zararları en az olacak şekilde otonom hassas vuruş" olarak anlatıyor.

25 dakika havada kalabilen İHA 5 kilometre menzile sahip. 2,8 kilometreye kadar yükselebilen Kargu'nun maksimum hızı ise saatte 72 km.

A Haber Eylül 2018'de Kargu'nun Türk Silahlı Kuvvetleri'ne (TSK) teslim edildiğini duyurmuştu.

Anadolu Ajansı'nın haberine göre bu araçlar Ankara'daki OSTİM Teknopark'ta üretiliyor. Ajans 2020'de yayınladığı haberde STM'nin 500 adet Kargu'yu TSK'ye teslim etmeye hazırlandığını yazmıştı.

Haberde 1-1,5 yıl içinde Kargu-2'lerin sürü halinde de kontrol edebileceği aktarılmıştı. STM'nin YouTube hesabında yayınladığı videoda da bu özellik gösteriliyor.

Bu teknolojiye değinen bir BM Silahsızlanma Araştırmaları Enstitüsü raporunda, sürü halinde işleyen otonom sistemlerin öngörülebilirliğinin azaldığı vurgulanmıştı.

Kargu-2'nin şu anki özellikleri, fiyatı ve alıcı ülkeler hakkında Kargu'nun üreticisi STM'ye sorular sormak istedik fakat iş yoğunlukları nedeniyle yanıt veremeyeceklerini öğrendik.

BBC Türkçe'ye konuşan savunma alanındaki itibarlı dergilerden IHS Jane's Defence Weekly'nin Orta Doğu ve Afrika Editörü Jeremy Binnie, Kargu-2'nin muhtemelen araçlar ve insanlar arasında ayrım yapabildiğini fakat farklı araç türlerini birbirinden ayırmak gibi yeteneklerinin olup olmadığının bilinmediğini söyledi.

Otonom sistemler neden eleştiriliyor?

Otonom sistemler birden fazla nedenden ötürü eleştiriliyor.

Birincisi teknik nedenlerden kaynaklanıyor. Görüntü işleme teknolojisi hâlâ mükemmellikten uzak olduğu için otonom bir SİHA, bir ağaç siluetini bir insanla karıştırabiliyor. Bu da cihazın yanlış karar vermesine yol açabiliyor.

Bu aletlerin geliştirilmesi ve kullanımı hakkında etik ve hukuki eleştiriler de var.

BBC Türkçe'ye konuşan bilim ve teknoloji felsefecisi, New York'taki The News School'dan Doç. Dr. Peter Asaro, "İnsanların bir yapay zekalı robot tarafından öldürülmesine izin vermenin ne kadar etik olduğu, yanlış kişilerin ölümüne yol açması durumunda bundan kimin sorumlu tutulacağı ve bu konuda uluslararası hukukun nasıl değişmesi gerektiği büyük birer tartışma konusu" diyor.

Uluslararası Robot Silah Kontrolü Komitesi Başkan Yardımcısı ve Katil Robotları Durdurun Kampanyası Sözcüsü de olan Asaro "Bu sistemlerin teröristler tarafından hacklenmesi veya otoriter diktatörler tarafından kendi halklarına karşı kullanılması" ihtimalinin de endişe verici olduğunu söylüyor.

Asaro günümüzde bir savaşta bir grup askerin bir köydeki sivilleri öldürmesi durumunda savaş suçları mahkemesi kurulacağını fakat bu bir otonom yazılımın hatası sonucu gerçekleşirse bunun bir kaza olarak değerlendirileceğini, muhtemelen kimsenin ceza almayacağını anlatıyor:

"Savaşlarda bu tür kazalardan genellikle taraflar sorumlu tutulmuyor. Sorumlular 'otonom SİHA'nın sivilleri öldüreceğini bilmiyordum' demesi durumunda yargılanamaz, bu bir savaş kazası olarak kayıtlara geçer.

"Otonom sistemlerin askeri ve sivil amaçlı kullanımlarında sorumluluk burada farklılaşıyor: Örneğin otonom bir araç yayaları ezse şirket büyük bir tazminat ödeyebilir fakat otonom bir SİHA yanlışlıkla sivilleri öldürürse üreticiye dava açılmıyor."

Jane's Defence Weekly Editörü Binnie, "katil robotların" bilinenden daha uzun süredir aramızda olduğunu söylüyor:

"Üzerlerindeki radarlarını kullanarak kendi hedeflerine karar veren gemi torpidoları bir süredir kullanımda.

"Bu torpidolar ateşlendikten sonra onu ateşleyen kişinin hiçbir yönlendirme olanağı kalmıyor.

"Bunların hatalı kararlarının örneklerini daha önce gördük: 2006'da Hizbullah bir İsrail savaş gemisini hedef aldı fakat bir kargo gemisini batırdı.

"Yeni nesil torpidolar ise gemileri ayırt etmeyi başarıyor. Bu yüzden yüksek teknoloji otonominin bu alanda işe yaradığını söyleyebiliriz."

Otonom silahlara dair etik tartışmalara yanıtlarının ne olduğunu ve hangi etik uzmanlarıyla çalıştıklarını sormak için Kargu'nun üreticisi STM ile iletişime geçtik fakat iş yoğunlukları nedeniyle yanıt veremeyeceklerini öğrendik.

BM'nin raporunda Kargu ile ilgili neler yazıyor?

BM kararıyla kurulan Libya Uzmanları Paneli, Libya'daki gelişmelere dair 8 Mart'ta Güvenlik Konseyi Başkanlığı'na 548 sayfalık bir rapor sundu.

Uzmanlar raporda 27 Mart 2020'de Libya Ulusal Mutabakat Hükümeti Başbakanı Fayez Sarrac'ın "Barış Fırtınası Operasyonu'nu" başlatmasının ardından geri çekilmek zorunda kalan Halife Hafter güçlerine Kargu-2 ile saldırılar düzenlendiğini söyledi:

"İnsansız hava araçları veya STM Kargu-2 gibi öldürücü otonom silah sistemleri ve diğer kamikaze drone'ları kullanılarak lojistik konvoyları ve geri çekilmekte olan Hafter güçlerinin peşine düşüldü.

"Öldürücü otonom silah sistemleri, operatör ile veri bağlantısına ihtiyaç duymadan saldırı düzenleyecek şekilde programlanmıştı: Bu gerçek bir 'ateşle, unut ve bul' özelliğiydi.

"Hafter'in istihbarat ve gözetim için kullandığı az sayıdaki insansız hava aracı ise Koral elektronik savaş sistemleri tarafından elektronik sinyaller aracılığıyla etkisiz hale getirildi."

Libya'da Hafter güçlerine Birleşik Arap Emirlikleri tarafından verilen Pantsir S-1 hava savunma sistemlerinin imha edilmesi geçen yıl ses getirmişti.

BM raporunda, bu saldırıda ölümcül otonom silah sistemlerinin de kullanıldığını ve bunun son derece etkili olduğunu ifade edildi.

Doç. Dr. Asaro, BM raporunda bu silahların çekilmekte olan askerlere karşı kullanılmasının yarattığı etik sorunlara da dikkat çekti:

"Bunların bir kısmı yaralı askerler olabilir ve Cenevre Sözleşmesi'ne göre bu askerlerin hedef alınması yasaktır.

"Dahası, bu askerler beyaz bayrak sallayarak teslim olmaya çalışıyor da olabilirdi. Otonom bir sistemin bunu algılayıp algılamayacağını bilmiyoruz.

"Daha önce Azerbaycan'ın İsrail tarafından geliştirilen bir VİHA ile benzer saldırılar yaptığını biliyoruz. Bu aracın otonom olmayan bir versiyonu da var ve saldırıda hangisinin kullanıldığını tespit etmek mümkün değildi. Üstelik saldırılanlar da bir okul otobüsüne bindirilmiş bir grup yedek askerdi. Bu saldırının neden yapıldığını anlayamamıştık."

Jane's Defence Weekly'den Jeremy Binnie de daha önce otonom özelliği olan Polonya yapımı WB Warmate'in Libya'da görüntülendiğini, bu olayın otonom bir hava aracının bir savaşta kullanıldığı ilk olay olmadığını söylüyor.

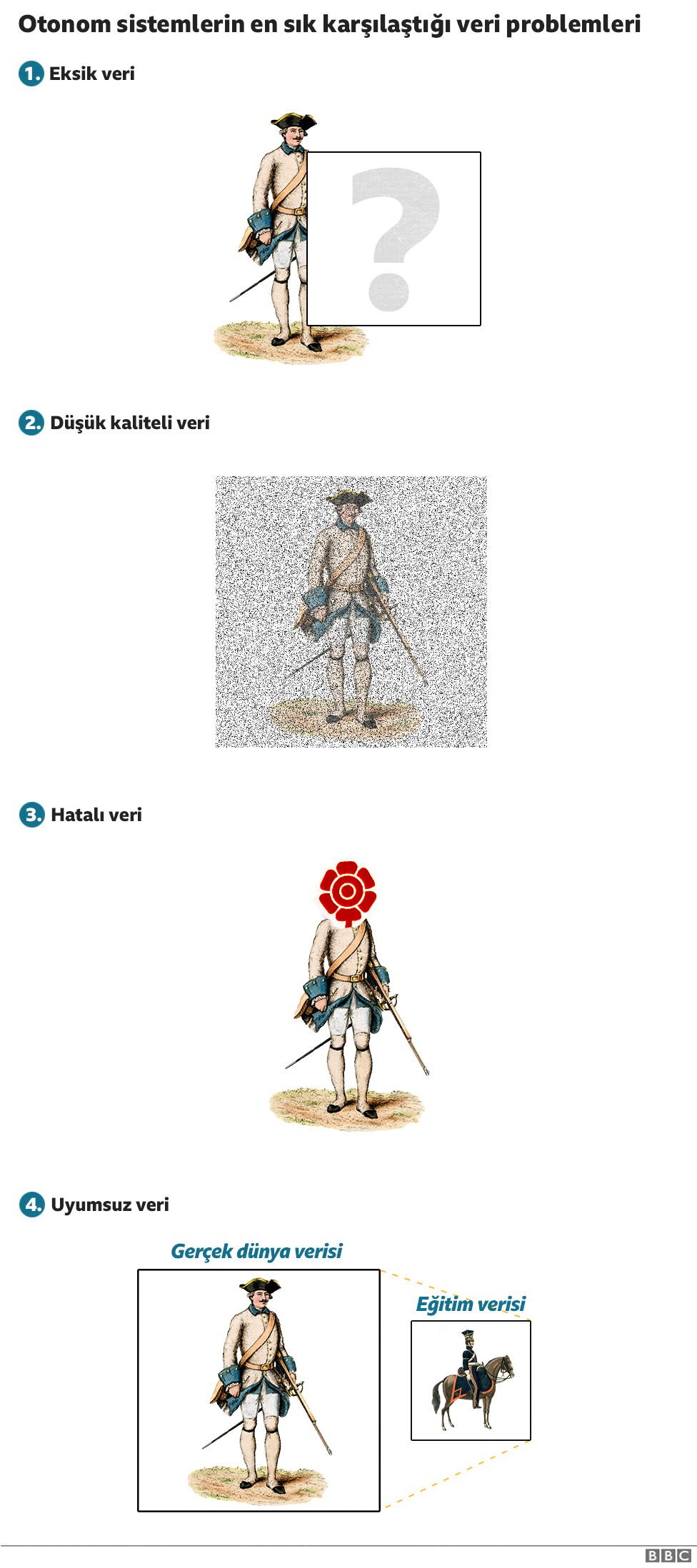

Raporun 30 sayılı ekinde de Libya'da kullanıldıktan sonra kalıntısı bulunan bir Kargu-2'nin fotoğraflarına yer verildi.

Sirte ile Mısrata arasında bulunan Ebu Kureyn kasabasında 25 Mayıs'ta bulunan Kargu-2'nin Ocak 2020'de piyasaya sürüldüğü ve yalnızca Türk Silahlı Kuvvetleri'nin envanterinde yer aldığı belirtildi.

Raporun 30 numaralı ekinde "Türkiye'nin Libya'ya bu sistemi göndermesi 1970 sayılı kararının 9. paragrafını (silah ambargosunu düzenleyen paragraf) ihlali anlamına gelmektedir" ifadeleri yer aldı.

Raporda Türkiye'nin 23 Ekim 2019 ile 30 Kasım 2020 tarihleri arasında 26 ayrı ihlal gerçekleştirdiği aktarıldı.

Libya'daki Ulusal Mutabakat Hükümeti'nin 2 Haziran ile 3 Kasım 2019 tarihleri arasında Cumhurbaşkanlığı Savunma Sanayii Başkanlığı'na ait SSTEK Savunma Sanayi Teknolojileri AŞ'ye üç ayrı seferde toplam 409,3 milyon euroluk para transferi emri verdiği de belirtildi ve bunların belgeleri yer aldı.

Öte yandan Ürdün, Birleşik Arap Emirlikleri, Mısır, Suriye ve Rusya'nın da Halife Hafter lehine defalarca silah ambargosunu deldiği aktarıldı.

Panel, raporda işlenen konularla ilgili Ürdün, Türkiye ve Birleşik Arap Emirlikleri'ne sorular sorduklarını fakat yanıt veya detaylı bilgi alamadıklarını açıkladı.

Otonom Silahsızlanma Araştırmaları Enstitüsü'nün önerileri neler?

Öldürücü otonom silah sistemleri, yapay zekanın gelişmeye başlamasıyla birlikte insan hakları, etik ve teknoloji alanında çalışan pek çok uzmanın uyarılarına yol açtı.

Bu konuda Avrupa Birliği ve Birleşmiş Milletler'e çok sayıda çağrı yapıldı.

Birleşmiş Milletler Silahsızlanma Araştırmaları Enstitüsü (UNIDIR) de Mayıs 2021'de otonom askeri sistemlerin sorunları hakkında kapsamlı bir rapor yayımladı.

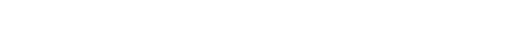

Raporda tüm otonom sistemlerin çevrelerinden topladıkları verilere göre karar verdiği hatırlatıldı:

"Gerçek dünyada data hiçbir zaman kusursuz değildir. Daha da önemlisi karmaşık ve öngörülemez şekillerde kusursuzluktan uzaktır. Data sorunlarıyla karşılaşan otonom sistemler bu nedenle karmaşık ve öngörülemez hatalara yol açabilir.

"Bu yüzden otonom sistemlerin data sorunları nedeniyle hatalı işlemesi, hem kaçınılmaz hem de beklenmedik olabilir.

"Bu sistemler her zaman sorunlu ve öngörülemez verilerle karşı karşıya kalacak."

Raporu hazırlayan Arthur Holland Michel, bu cihazların geliştirildiği laboratuvar koşullarında verilerin kontrol altında olduğunu fakat bir savaş ortamında bölgeden toplanacak verileri test etmenin mümkün olmadığını belirtiyor.

Michel, bir otonom silah sisteminin yanlış kişiyi öldürmesi durumunda bunun sorumluluğunun kimde olduğunun tartışmalı olduğunu, sistemin sorunlarının ne ölçüde bilindiği gibi soruların gerçek yanıtlarını bulmanın zor olabileceğini söylüyor.

Michel bu rapor için söyleşi yaptığı tüm uzmanların, otonom silahları kullanan tarafların istenmeyen zararları önleme konusunda gerekli adımları atmadığının ortaya çıkması durumunda, söz konusu tarafların sorumlu tutulacağını söylediğini aktarıyor.

Michel'e göre tüm otonom silah kullanıcılarının, bu sistemlerde ne gibi sorunların oluşabileceğini bilip, buna hazırlık yapıp, gerekli çözümleri de uygulayabilecek kapasitede olması gerekiyor.

Bazı devletlerin güvenilirliği daha düşük otonom silahları kullanmasıyla birlikte diğer devletlerin de sahadaki avantajlarını kaybetmemek için benzer bir yola gidebileceğini belirten Michel, bunun güvenlik alanında "dibe doğru bir yarış" anlamına geleceği uyarısında bulunuyor.

Michel'in BM için hazırladığı raporda bu sorunlar karşısında altı çözüm önerisi yer alıyor:

1. Otonom silahların tamamen veya kısmen yasaklanması

Bu tür silahların yasaklanmasına yönelik çağrılar bir süredir mevcut olsa da devletler bu yönde bir adım atmakta isteksiz. Öte yandan büyük bir kısmı otomatik olan silah sistemleriyle otonom sistemler arasındaki çizginin nerede olduğu konusunda da fikir birliği bulunmuyor. Bazı uzmanlar ise bu tür sistemlerin insanlara karşı kullanımının yasaklanmasının daha kolay bir öneri olacağı görüşünde.

2. Doğrudan insan kontrolü

Otonom sistemlerin başında sürekli olarak bir insan bulunması ve riskli durumlarda müdahale etmesine yönelik bir uluslararası yasa da uzmanların önerileri arasında yer alıyor.

Öte yandan beklenmedik hatalar karşısında insanların da her zaman doğru kararları verebileceğinin bir garantisi bulunmuyor. Bir hata durumunda cihazın başındaki operatörün mü, yoksa operasyona karar veren daha üst düzey bir yetkilinin mi sorumlu tutulacağı da bir diğer tartışma konusu.

3. Sorumluluğun belirlenmesi

Uluslararası toplum, bu sistemlerin istenmeyen zararlar vermesi durumunda her zaman bir insanın sorumlu tutulması gerektiğinde hemfikir.

Mevcut yasal çerçeveler hata, özensizlik ve bilinçli taksir gibi konularda tarafları sorumlu tutuyor. Fakat herhangi bir istenmeyen zarar durumunda bunun öngörülebilir olup olmadığını belirlemek son derece zor.

Bu yüzden bazı uzmanlar bu tür detaylara girmeksizin, devletlerin her koşulda istenmeyen zararlardan ötürü sorumlu tutulmasını talep ediyor. Bu görüşteki uzmanlar, sorumlu tutulan devletlerin bu tür hataların önüne geçme veya kullanımda daha dikkatli olma konusunda daha fazla motivasyona sahip olacağını öne sürüyor.

4. Zorunlu denetim

Bir otonom silah sisteminin ne kadar güvenilir olduğu konusunda yasa yapıcıların karar almasını kolaylaştırmanın bir yolu olarak zorunlu denetim uygulaması öneriliyor.

Bu öneriye göre bir grup bağımsız uzmanın geliştirilen otonom silahı denetleyerek bunların hata payını, güvenilirliğini ve olası veri sorunlarını ortaya koyması gerekiyor.

Bunun ardından da üreticinin bu önerilerden yola çıkarak sistemindeki eksiklikleri tamamlaması bekleniyor.

5. Tekrarlayan denetim

Otonom silah sistemlerinin beklenmedik hatalar yapması kaçınılmaz olduğu için bazı uzmanlar tespit edilen her hatadan sonra bütün sistemlerin baştan sona denetlenerek aynı hatanın diğer sistemlerde de oluşmasının önüne geçilmesine yönelik bir yasal düzenleme gerekiyor.

Fakat bazı sistemlerde çok sık hata tespit edilmesi durumunda bunun uygulanmasının zorlaşacağı da raporda vurgulanıyor.

6. Standartlar ve bilgi paylaşımı

Çok sayıda uzman, bu konularda devletlerin bir standart geliştirmesi ve bilgi paylaşması gerektiğini savunuyor.

Öte yandan askeri bilgilerin pek çok ülkede gizli olması nedeniyle devletleri buna ikna etmenin zor olabileceği belirtiliyor.

SİHA'ların ordular için önemi artarken yasak gelebilir mi?

Son yıllarda Libya ve Kafkasya'da yaşanan savaşlarda Türkiye'nin ürettiği SİHA'ların sahadaki gidişatı değiştirmesi, dünya genelinde bu silahlara yönelik ilgiyi de artırdı.

Türkiye, Çin, ABD ve İsrail bu silahların ihracatından önemli bir gelir elde ediyor.

Peki bu tabloda BM'de bu silahların kullanımına dair bir kısıtlama çıkmasını beklemek gerçekçi mi?

Doç. Dr. Asaro gerçekçi olduğu görüşünde:

"Otonom SİHA'lar henüz çok yeni ve hiçbir ordu henüz bunlara bağımlı değil. Bu sayede ülkelerin bir anlaşma imzalaması daha muhtemel.

"Bunların satışından para kazanan ülkeler karşı çıksa da buna benzer bir örneği Nükleer Silahların Yayılmasını Önleme Anlaşması'nda gördük:

"Nükleer silahı olan ülkeler imzalamasa da 100'den fazla ülke bu anlaşmaya taraf oldu ve böylece uluslararası kamuoyunun bu silahların kullanımını doğru bulmadığı mesajı verildi.

Kimyasal veya biyolojik silahların yasaklanması da benzer bir mücadelenin sonucu gerçekleşti.

"Otonom silahlar konusunda da ABD, Rusya ve Çin gibi büyük ülkelerin stratejik istikrar açısından böylesi bir anlaşmayı destekleyeceğini düşünüyorum. Soğuk Savaş dönemindeki nükleer silah yarışının bir benzerinin yaşanmasının önüne ancak böyle geçebilirler."

Asaro BM'de 30'dan fazla ülkenin, ölümcül otonom silah sistemlerinin başlarında son kararı veren birer insan bulunmasına ve bu sistemlerin bireyleri değil yalnızca tank ve savaş uçakları gibi araçları hedef alabilmesine yönelik bir girişimi desteklediğini söylüyor.

Bu ülkelerin çoğunun Bağlantısızlar Hareketi'nden olduğunu aktaran Asaro, Avrupa'dan da Belçika ve Avusturya'nın desteklediğini belirtiyor.

Jane's Defence Weekly'den Jeremy Binnie de bu yönde çağrıların olduğunu fakat pek çok ülkede orduların daha fazla otomasyon kullanmak istemesi nedeniyle böylesi bir sözleşmeye yönelik direnç olduğunu söylüyor:

"Bu sistemlerin başında ne kadar insan denetimi olması gerektiği konusunda herkesin kabul edebileceği bir tanım bulmak zor olabilir.

© Tüm hakları saklıdır.

Yazarlar

- Adnan Ekinci

- Ahmet Sever

- Ahmet Talimciler

- Akdoğan Özkan

- Alex Akimoğlu

- Ali Akay

- Atilla Dorsay

- Aydın Engin

- Ayfer Feriha Nujen

- Aysel Sağır

- Ayşe Acar

- Barçın Yinanç

- Bekir Ağırdır

- Candan Yıldız

- Cemal Tunçdemir

- Çağnur Öztürk

- Çiğdem Anad

- Deniz Can

- Doğan Akın

- Emrah Akın

- Ercan Uygur

- Erdoğan İşcan

- Erdoğan Sağlam

- Faruk Bildirici

- Fulya Canşen

- Füsun Sarp Nebil

- Gökçer Tahincioğlu

- Gönenç Gürkaynak

- Hakan Aksay

- Hande Çayır

- Hasan Cemal

- Hasan Göğüş

- Hasan Servet Öktem

- İrfan Yalın

- İskender Aruoba

- Leyla Alp

- M. K. Perker

- Mehmet Y. Yılmaz

- Mehmet Y. Yılmaz | Futbol

- Mehmet Y. Yılmaz | Hafta Sonu

- Mehmet Yalçın

- Murat Batı

- Murat Belge

- Murat Bjeduğ

- Murat Sabuncu

- Mustafa Durmuş

- Oğuz Demiralp

- Orhan Tekelioğlu

- Oya Baydar

- Pınar Doğu

- Rıdvan Akar

- Rıza Türmen

- Selçuk Demirel

- Sencer Ayata

- Seyfettin Gürsel

- Süheyl Aygül

- Şenay Tanrıvermiş

- Şengün Kılıç

- Şirin Payzın

- Şükrü Hatun

- Talat Kırış

- Tan Oral

- Tolga Şardan

- Tolga Şirin

- Tuğçe Tatari

- Tuğrul Akşar

- Tuğrul Eryılmaz

- Türkay Demir

- Uğur Gürses

- Umut Ozan Darıcı

- Yalçın Doğan

- Yılmaz Murat Bilican

- Yusuf Nazım

- Zeynel Lüle